MÉTODO DE RESOLUCIÓN DE GAUSS-JORDAN

Es el método de resolución de sistemas de ecuaciones lineales, que consiste en llegar a un sistema "escalonado" transformando la matriz ampliada en una matriz escalonada por filas. El método de Gauss es una generalización del método de reducción, que utilizamos para eliminar una incógnita en los sistemas de dos ecuaciones con dos incógnitas. Consiste en la aplicación sucesiva del método de reducción, utilizando los criterios de equivalencia de sistemas, para transformar la matriz ampliada con los términos independientes ( A* ) en una matriz triangular, de modo que cada fila (ecuación) tenga una incógnita menos que la inmediatamente anterior. Se obtiene así un sistema, que llamaremos escalonado, tal que la última ecuación tiene una única incógnita, la penúltima dos incógnitas, la antepenúltima tres incógnitas, ..., y la primera todas las incógnitas.

El siguiente esquema muestra cómo podemos resolver un sistema de ecuaciones lineales aplicando este método.

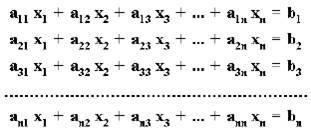

Partimos, inicialmente, de un sistema de n ecuaciones lineales con n incógnitas, compatible determinado:

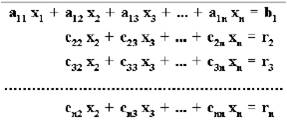

En primer lugar, aplicando sucesivamente el método de reducción, eliminamos en todas las ecuaciones, excepto en la primera, la incógnita x1, obteniéndose un sistema equivalente:

En segundo lugar, aplicando nuevamente el método de reducción de forma sucesiva, eliminamos en todas las ecuaciones, excepto en las dos primeras, la incógnita x2, obteniéndose un sistema equivalente:

Para resolverlo despejamos, en primer lugar, la única incógnita de la última ecuación. Luego sustituimos ésta en la penúltima ecuación y despejamos la otra incógnita. Posteriormente, sustituimos dos de las tres incógnitas de la antepenúltima ecuación por sus valores y despejamos la que queda, y así sucesivamente hasta llegar a la primera ecuación.

Las transformaciones que podemos realizar en dicha matriz para transformar el sistema inicial en otro equivalente son las siguientes:

- Multiplicar o dividir una fila por un número real distinto de cero.

- Sumarle o restarle a una fila otra fila.

- Sumarle a una fila otra fila multiplicada por un número distinto de cero.

- Cambiar el orden de las filas.

- Cambiar el orden de las columnas que corresponden a las incógnitas del sistema, teniendo en cuenta los cambios realizados a la hora de escribir el nuevo sistema equivalente. Es decir: si, por ejemplo, la 2ª columna corresponde a la incógnita y y la tercera a la incógnita z, y cambiamos el orden de las columnas, ahora la 2ª columna corresponde a la incógnita z y la tercera a la incógnita y.

- Eliminar filas proporcionales o que sean combinación lineal de otras.

- Eliminar filas nulas (0 0 0 ... 0).

Después de realizar las transformaciones que se consideren pertinentes, se obtendrá un sistema escalonado. Suponiendo que hubiésemos eliminado, si las hubiera, las filas nulas (0 0 0 ... 0), que corresponden a ecuaciones del tipo 0 = 0, el sistema equivalente tendría ahora k ecuaciones lineales con n incógnitas.

Analizando el sistema resultante, podemos efectuar su discusión del siguiente modo:

- Si alguna de las ecuaciones es del tipo 0 = b (siendo b distinto de cero), el sistema es incompatible y no tiene solución.

- Si no hay ecuaciones del tipo 0 = b, y además k = n, es decir, el número de ecuaciones del sistema equivalente es igual al número de incógnitas, el sistema es compatible determinado y, por lo tanto, tiene una única solución.

- Si no hay ecuaciones del tipo 0 = b y k < n, es decir, el número de ecuaciones es menor que el número de incógnitas, el sistema es compatible indeterminado y, en consecuencia, tiene infinitas soluciones. En este caso, tenemos que separar las incógnitas principales de las no principales.

Pero, ¿cuáles son las incógnitas principales? Se puede dar el siguiente criterio: Si el sistema es escalonado y tiene k ecuaciones, las k primeras incógnitas serán las principales y las n - k restantes serán las no principales que pasaremos al segundo miembro como parámetros.

MÉTODO DE RESOLUCIÓN DE CRAMER. REGLA DE CRAMER

La regla de Cramer utiliza las propiedades de las matrices y sus determinantes para despejar, por separado, una cualquiera de las incógnitas de un sistema de ecuaciones lineales.

REGLA DE CRAMER

Un sistema de ecuaciones lineales recibe el nombre de sistema de Cramer cuando se cumplen las dos condiciones siguientes:

- El número de ecuaciones es igual al número de incógnitas.

- El determinante de la matriz de los coeficientes (matriz del sistema) es distinto de cero (det ( A ) ≠ 0)

Un sistema de Cramer es, por definición, compatible determinado, puesto que se cumple que rango (A) = rango (A*) = n (nº de incógnitas).

Consideremos un sistema de Cramer, es decir, un sistema de n ecuaciones lineales con n incógnitas, cuya expresión general es la siguiente:

Sean A la matriz del sistema , entonces det (A)

≠0.

Llamaremos matriz asociada a la incógnita xi y la designaremos por Ai a la matriz que se obtiene al sustituir en la matriz del sistema la columna i por la matriz columna de los términos independientes. Es decir:

Todos los sistemas de Cramer son compatibles determinados. El valor de cada incógnita se obtiene dividiendo el determinante de la matriz asociada a dicha incógnita por la matriz del sistema (matriz de los coeficientes de las incógnitas).

¿Se puede aplicar la regla de Cramer para resolver sistemas de ecuaciones lineales compatibles que tengan más ecuaciones que incógnitas? La respuesta es afirmativa. Basta con obtener un sistema equivalente al inicial eliminando las ecuaciones superfluas o dependientes (proporcionales, nulas o que sean combinación lineal de otras).

El procedimiento a seguir es el siguiente: Supongamos que tenemos un sistema de m ecuaciones lineales con n incógnitas, siendo m > n y tal que: rango (A) = rango (A*) = n. Por lo tanto, sobran m - n ecuaciones. Para averiguar cuáles son las ecuaciones de las que podemos prescindir, basta encontrar en la matriz de los coeficientes ( A ) un menor de orden n distinto de cero, por ejemplo, el que utilizamos para averiguar el rango de la matriz A.

Las filas que intervienen en este menor son las que corresponden a las ecuaciones principales. Las restantes ecuaciones las podemos suprimir.

Ejemplo: Sea el sistema de ecuaciones lineales formado por dos ecuaciones con dos incógnitas:

Encontrar el valor de x e y mediante la regla de Cramer.

Empezaremos con el primer paso, que consiste en hallar la matriz ampliada A b asociada al sistema de ecuaciones lineales:

El segundo paso es calcular el determinante de A. Así pues:

Y el tercero y último paso consiste en calcular las incógnitas:

MÉTODO DE LA MATRIZ INVERSA

Consideremos un sistema de n ecuaciones lineales con n incógnitas, cuya expresión general es la siguiente:

Hemos visto que este sistema se puede escribir en forma matricial del siguiente modo: A X = B.

La matriz A se llama matriz del sistema, es de dimensión n x n y sus elementos son los coeficientes de las incógnitas.

La matriz X es una matriz columna, de dimensión n x 1, formada por las incógnitas del sistema. Por último, la matriz B es otra matriz columna, de dimensión n x 1, formada por los términos independientes. Es decir:

Si el determinante de la matriz A es distinto de cero (det (A) ≠ 0 ), la matriz A tiene inversa ( A-1 ). Por lo tanto, podemos calcular la matriz de las incógnitas X del siguiente modo:

Es decir, para calcular la matriz columna de las incógnitas ( X ), multiplicamos la inversa de la matriz A ( A-1 ) por la matriz columna de los términos independientes, obteniéndose otra matriz columna de la misma dimensión que X.

¿Se puede aplicar el método de la matriz inversa para resolver sistemas de ecuaciones lineales compatibles que tengan más ecuaciones que incógnitas? La respuesta es afirmativa. Basta con obtener un sistema equivalente al inicial eliminando las ecuaciones superfluas o dependientes (proporcionales, nulas o que sean combinación lineal de otras).

El procedimiento a seguir es el siguiente: Supongamos que tenemos un sistema de m ecuaciones lineales con n incógnitas, siendo m > n y tal que: rango (A) = rango (A*) = n. Por lo tanto, sobran m - n ecuaciones. Para averiguar cuáles son las ecuaciones de las que podemos prescindir, basta encontrar en la matriz de los coeficientes ( A ) un menor de orden n distinto de cero, por ejemplo, el que utilizamos para averiguar el rango de la matriz A. Las filas que intervienen en este menor son las que corresponden a las ecuaciones principales. Las restantes ecuaciones las podemos suprimir.

¿Se puede aplicar el método de la matriz inversa para resolver sistemas de ecuaciones lineales compatibles indeterminados? La respuesta es también afirmativa. El procedimiento a seguir es el siguiente: Supongamos que tenemos un sistema de m ecuaciones lineales con n incógnitas, tal que: rango (A) = rango (A*) = k < n. Por lo tanto, sobran m - k ecuaciones y, además, hay n - k incógnitas no principales. Para averiguar cuáles son las ecuaciones de las que podemos prescindir, y cuáles son las incógnitas no principales, basta encontrar en la matriz de los coeficientes ( A ) un menor de orden k distinto de cero, por ejemplo, el que utilizamos para averiguar el rango de la matriz A. Las filas que intervienen en este menor son las que corresponden a las ecuaciones principales o independientes. Las restantes ecuaciones las podemos suprimir. Las columnas que figuran en dicho menor corresponden a las incógnitas principales. Las incógnitas no principales las pasamos al otro miembro y pasan a formar un único término junto con el término independiente. Se obtiene, de este modo, un sistema de k ecuaciones lineales con k incógnitas, cuyas soluciones van a depender de n - k parámetros (correspondientes a las incógnitas no principales).

Esta feo eso de Gauss, no puedo entenderlo xd

ResponderEliminarx2 JAJAJAJA

Eliminarx3 alv :v

Eliminarx4 :´v

Eliminarx5 :'v

Eliminarx6 :v

Eliminarx7 :v

Eliminarx8 :'v

EliminarX9

Eliminarx10

Eliminarx11

Eliminarx12

Eliminarx13

Eliminarx14

EliminarX15

EliminarX16

Eliminarx17

EliminarQue se vaya a la verga el gauss jordan si o no raza?

ResponderEliminarNEL PRRO !! :v

Eliminarmejor ponte a estudiar o aprende a barrer

Eliminar